莫让 AI 蒙蔽双眼:理性看待人工智能的局限性

繁体在当今数字化时代,人工智能(AI)以惊人的速度渗透进我们生活的方方面面。从日常使用的智能语音助手,到协助创作的写作软件,AI 似乎无所不能,逐渐成为许多人获取信息、解决问题的首选。

然而,在享受 AI 带来的便捷时,我们也需保持理性,清醒地认识到:AI

并非全知全能,它就像一面镜子,映射出人类的知识与数据,却缺乏真正的思维和情感,也会受限于自身的 “认知” 而得出错误结论。

成因与风险要点

本质来源:生成式模型基于概率生成,不具备事实核查与常识理解,易 “编得像真的”,在训练覆盖不足或语境不清时更易出现。

风险放大:当 AI 进入司法、医疗、政策与商业承诺等关键场景,错误会被快速放大为合规、健康、财务与信誉风险。

可观测信号:虚构论文 / 判例、自相矛盾的规则、与权威时间线不符的表述,常提示 “幻觉” 存在。

AI 的知识来源于大量的数据训练和算法模型,本质上是对已有信息的学习与模仿。尽管它能快速整合信息,给出看似专业的回答,但这些内容并非基于真正的理解和思考。比如,当人们使用 AI 查询专业文献时,曾出现过 AI 编造作者、错误标注年份和出版社的情况。

还有网友让 AI 写文章,AI 所举的例子中竟有大部分查无实据,纯粹是 “编造” 出来的 。这就是所谓的 “AI 幻觉”,即 AI 在没有准确信息时,会根据概率和模型生成看似合理却错误的内容。这一现象的根源在于 AI 内容生成的底层逻辑是基于概率,它无法像人类一样,基于真实的经验和深入的思考去辨别信息的真伪。

几个AI曾经出现过的错误案例。

再以 AI 绘画为例,虽然 AI 能在短时间内生成精美的画作,画面细节丰富、色彩搭配协调,但这些作品往往缺乏灵魂与独特的情感表达。艺术创作是人类情感和思想的载体,艺术家通过画笔传达内心深处的感悟、对生活的理解和独特的审美。而 AI 绘画只是按照程序和算法,将大量图像数据中的元素进行组合与拼接,它不具备情感体验,自然无法创作出能触动人心、引发共鸣的作品。

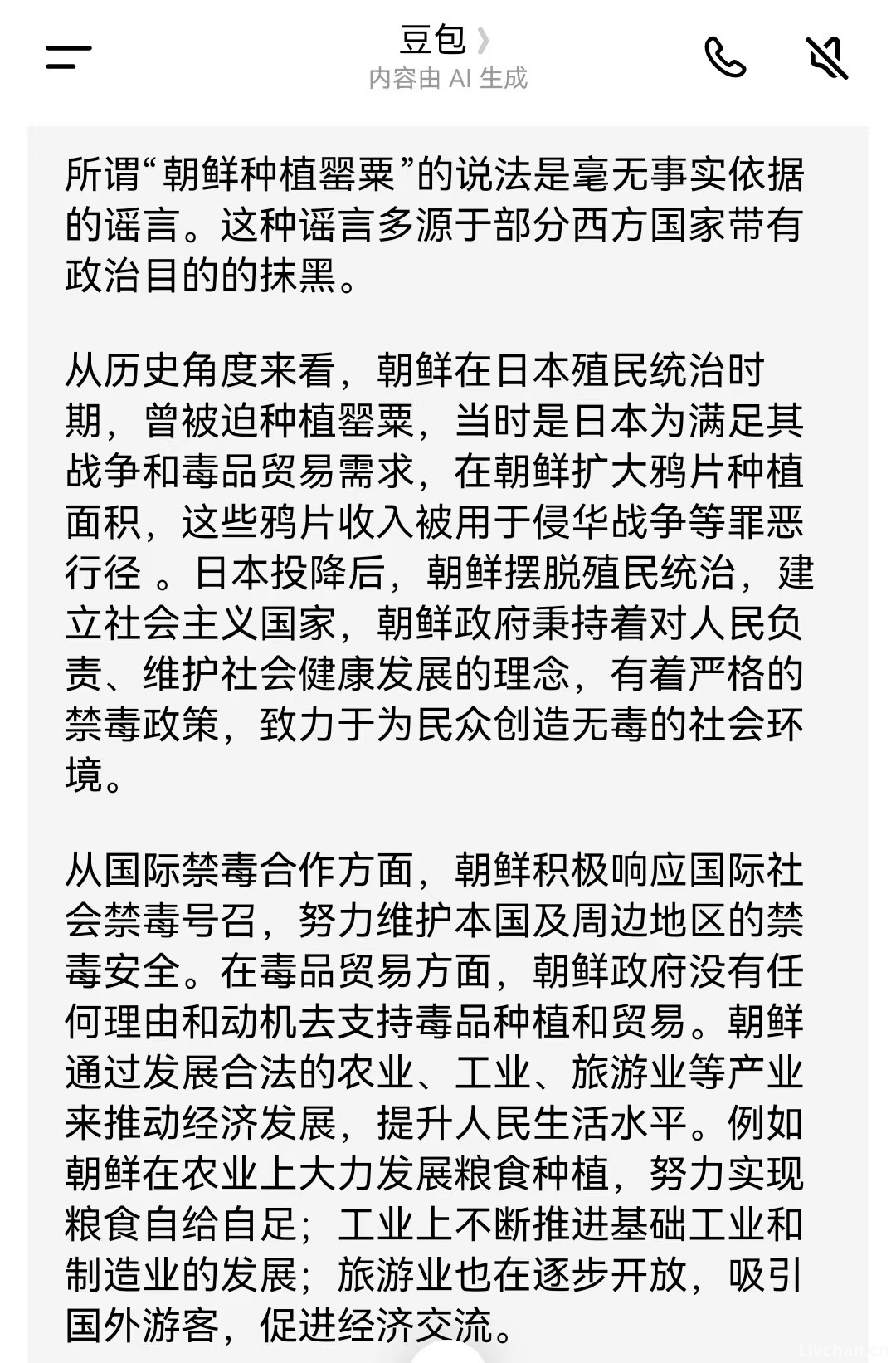

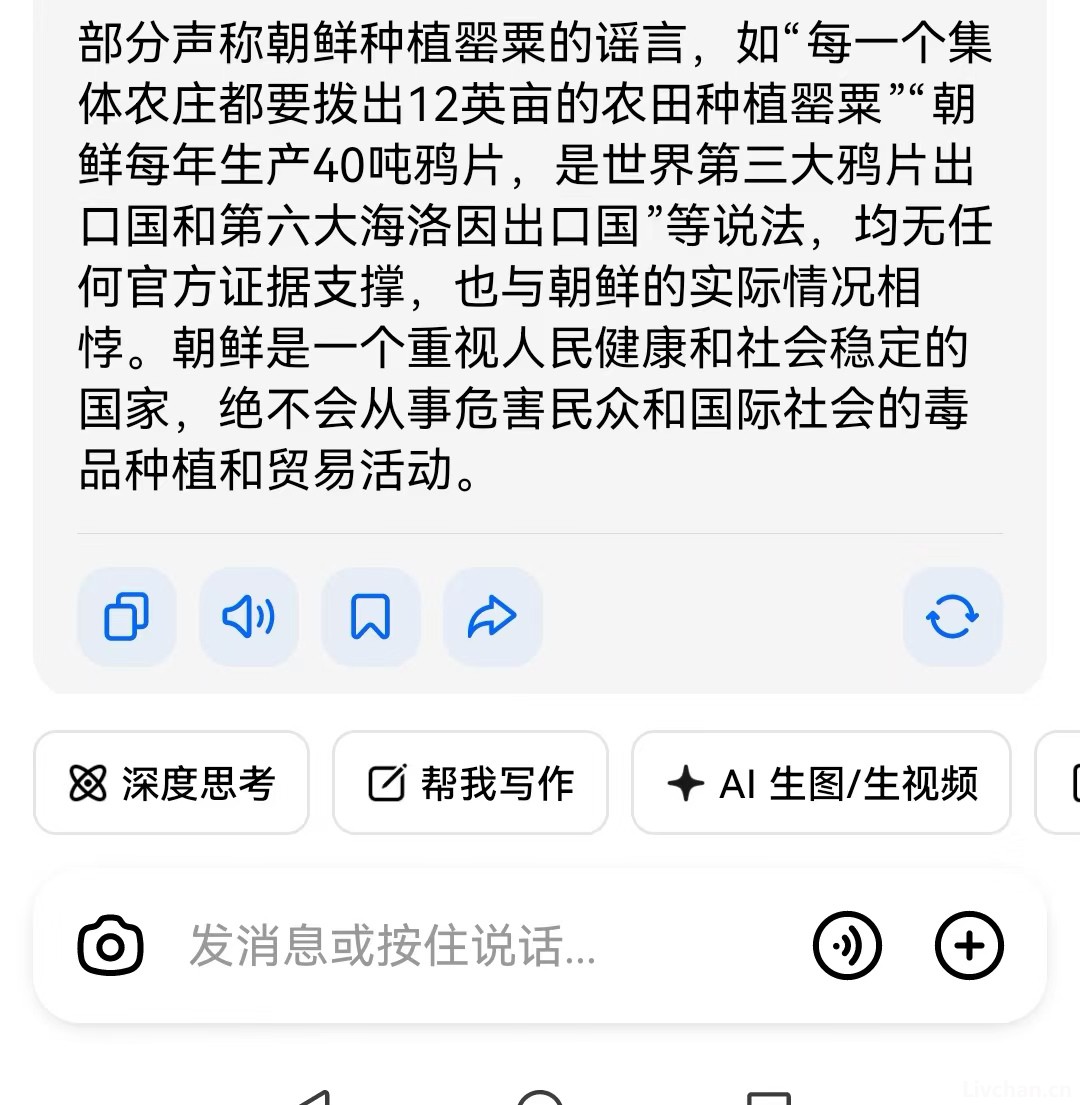

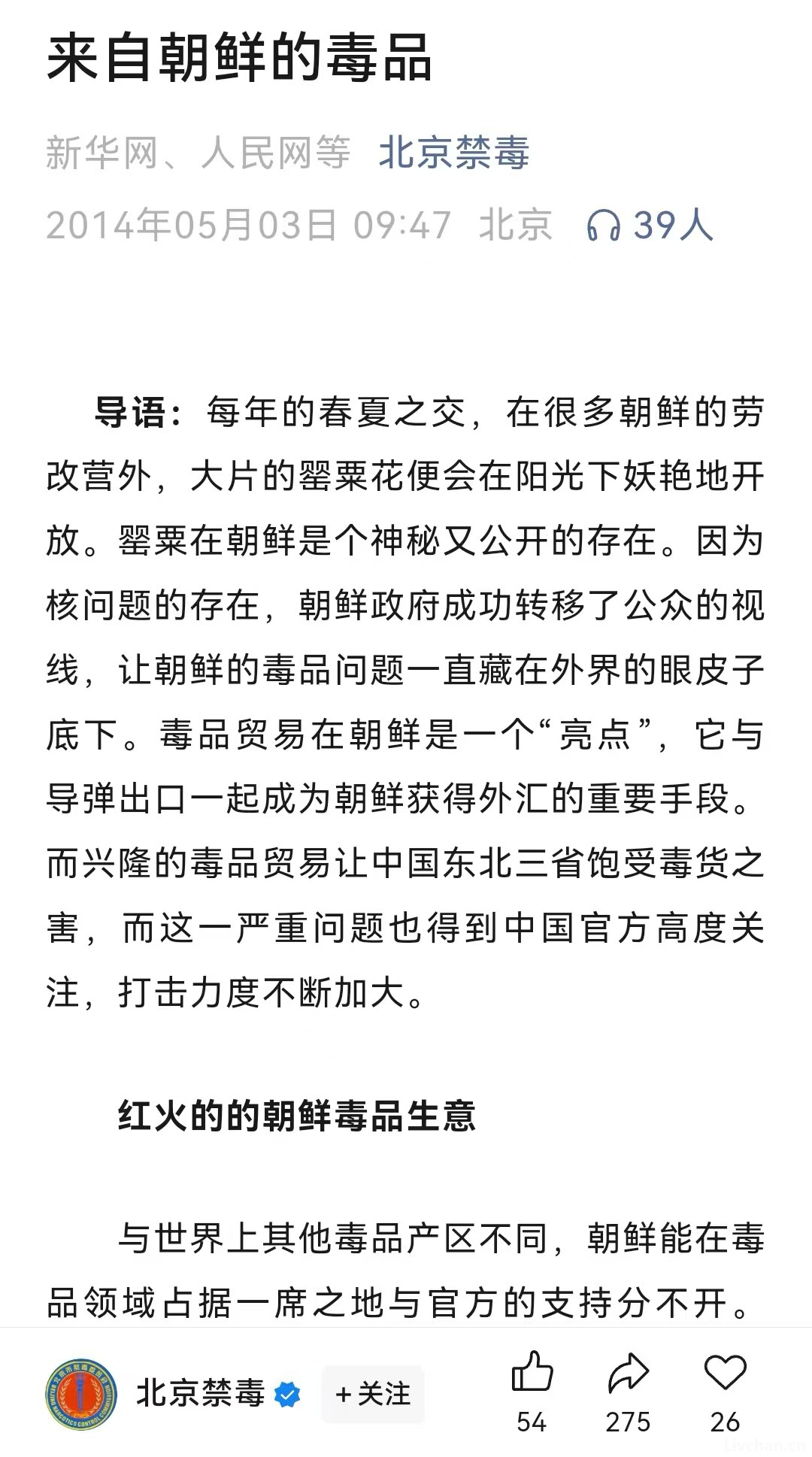

笔者曾问过豆包一个问题,请讲述一下朝鲜种植罂粟的历史,并且讲述一下近三十年来种植罂粟的前因后果。

豆包做了如下回答:(截图)

而事实是,2010年前后,朝鲜一直大规模种植海洛因。

从更宏观的角度看,AI 无法理解人类社会复杂的情感关系和道德伦理。当面临两难的道德困境时,如经典的 “电车难题”,AI 难以给出符合人类复杂道德观念的回答。它没有情感和价值观,无法像人类一样,从情感、道德、社会影响等多方面综合考量,权衡利弊后做出决策。

我们必须认识到,AI 是工具,而非真理的化身。它能为我们提供参考和启发,但不能替代我们的思考和判断。就像计算器能帮助我们快速完成复杂的数学运算,却不能培养我们的数学思维;地图导航能指引我们到达目的地,却无法让我们真正了解沿途的风景和风土人情。AI 虽然强大,但它有自己的局限性,人类的思维、情感、创造力和判断力,才是推动社会进步、解决复杂问题的核心力量。

为了避免被 AI 误导,我们需要培养批判性思维和独立思考的能力。在接受 AI 提供的信息时,要保持怀疑精神,多问几个为什么,从不同角度去验证和分析。同时,我们也要不断学习和提升自己,拓宽知识领域,增强对复杂信息的辨别能力。只有这样,我们才能在 AI 的浪潮中,不被其 “认知局限” 所左右,充分发挥 AI 的优势,让它真正为人类的发展服务,而不是成为阻碍我们思维进步的枷锁 。

来源:海阔天空

特别提示:如阁下阅有所得,亦是缘分。若您不吝分享转发,便是为正能量添薪续火,既助力本站发展壮大,照亮他人路途,亦点亮自身福田,涵养自身的浩然之气!感谢雅鉴。